Context Window Là Gì? Giới Hạn Bộ Nhớ AI Quan Trọng

Context window bị đầy là lý do Claude bắt đầu quên sau 50 lượt trao đổi. Bạn đang làm việc về một codebase phức tạp, Claude hỏi lại câu đã trả lời, không nhớ convention bạn thống nhất từ 30 tin nhắn trước. Không phải lỗi. Không phải Claude “lười”. Đây là giới hạn bộ nhớ làm việc của mọi AI.

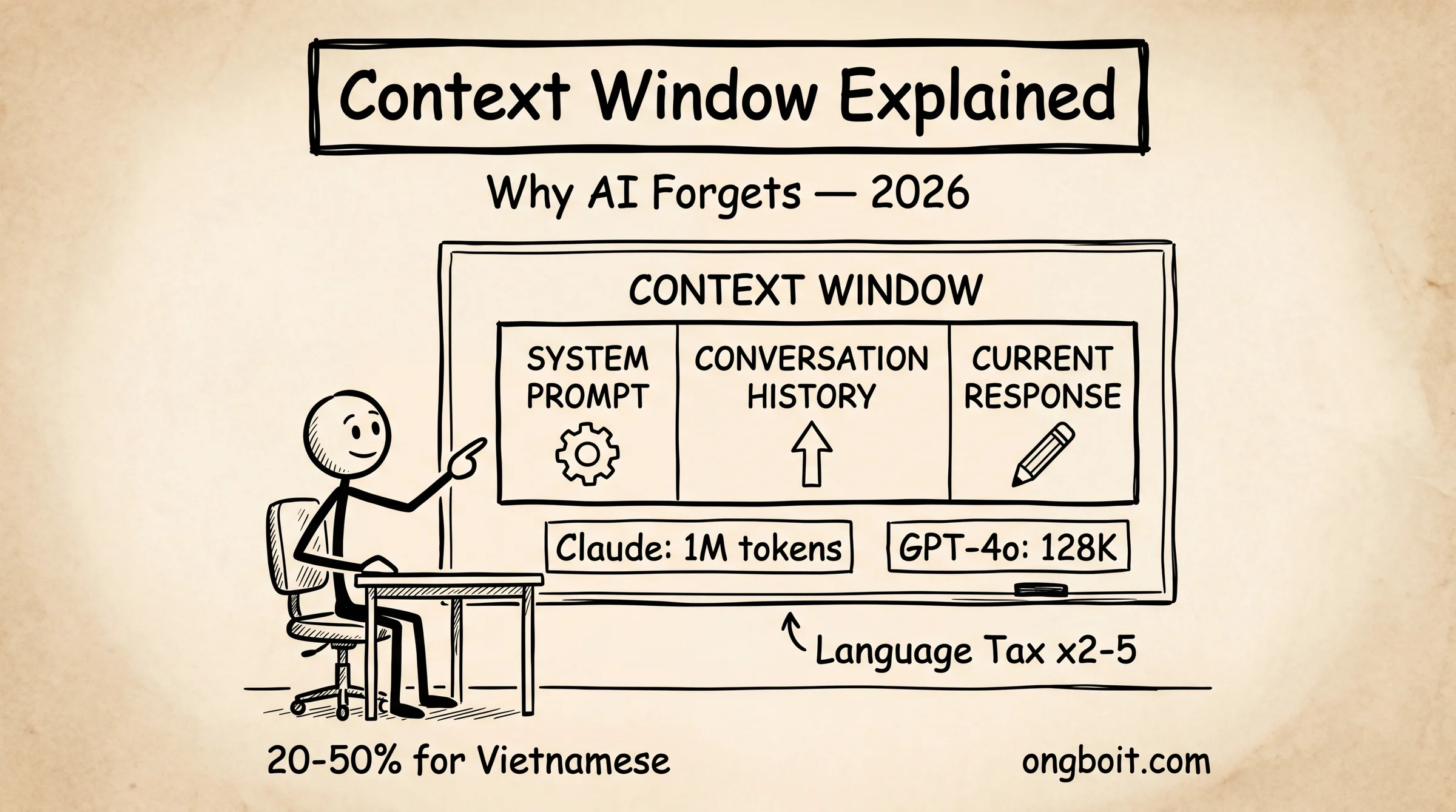

Context window là giới hạn bộ nhớ làm việc của mọi AI. Claude Sonnet 4.6 có context window 1 triệu token, GPT-4o có 128K. Nhưng với người dùng tiếng Việt, con số thực tế nhỏ hơn nhiều vì mỗi từ tiếng Việt tốn nhiều token hơn tiếng Anh. Khái niệm này gắn chặt với token và ảnh hưởng trực tiếp đến chi phí, hiệu suất khi dùng AI API.

Bài này giải thích context window là gì, tại sao developer Việt bị thiệt hơn người dùng tiếng Anh, và 4 cách quản lý khi context đầy.

TL;DR

- Context window là tổng số token AI đọc được trong một lần xử lý, bao gồm cả prompt, lịch sử hội thoại, và phản hồi.

- Claude Sonnet 4.6 có 1M token, GPT-4o có 128K. Nhưng tiếng Việt tốn 2-5x token, nên người Việt chỉ dùng được 20-50%.

- Khi context đầy, AI quên phần đầu cuộc trò chuyện, không phải bug.

- 4 cách quản lý: CLAUDE.md cho context tĩnh, /clear trước task mới, tóm tắt hội thoại, tách session theo chức năng.

Context window là “bàn làm việc” của AI. Mọi thứ phải vừa vào đây mới được xử lý. Claude Sonnet 4.6 có 1M token, nhưng người dùng tiếng Việt chỉ dùng được 20-50% do Language Tax.

Context Window Là Gì?

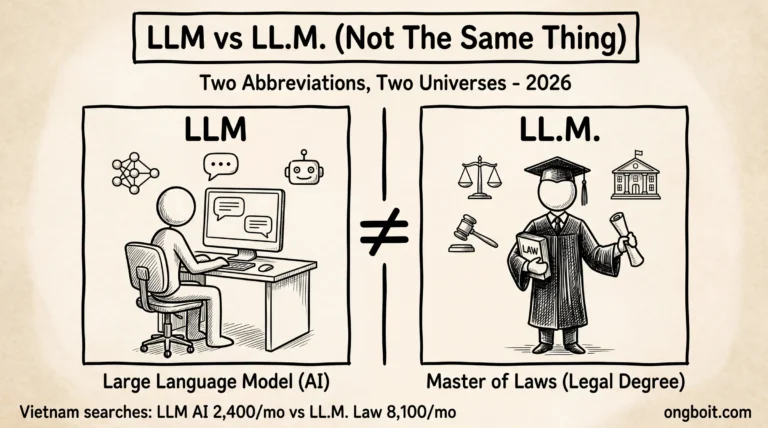

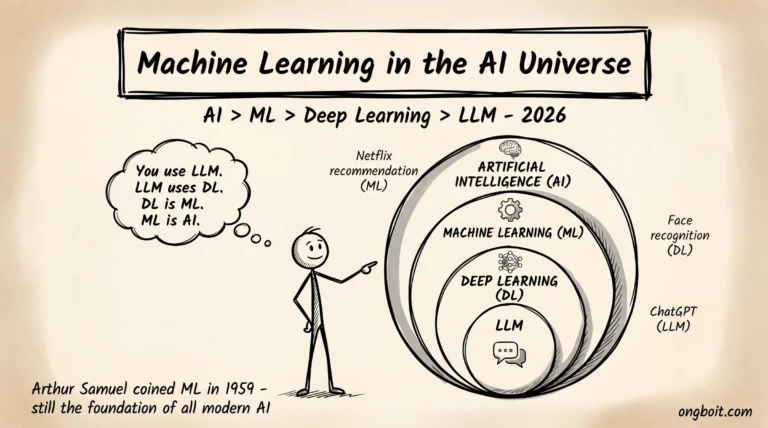

Context window là tổng số token tối đa mà một mô hình ngôn ngữ lớn (LLM) có thể đọc và xử lý trong một lần suy luận. Đây là “bàn làm việc” của AI: mọi thứ nằm trên bàn thì AI thấy và nhớ, mọi thứ bị đẩy ra khỏi bàn thì AI quên.

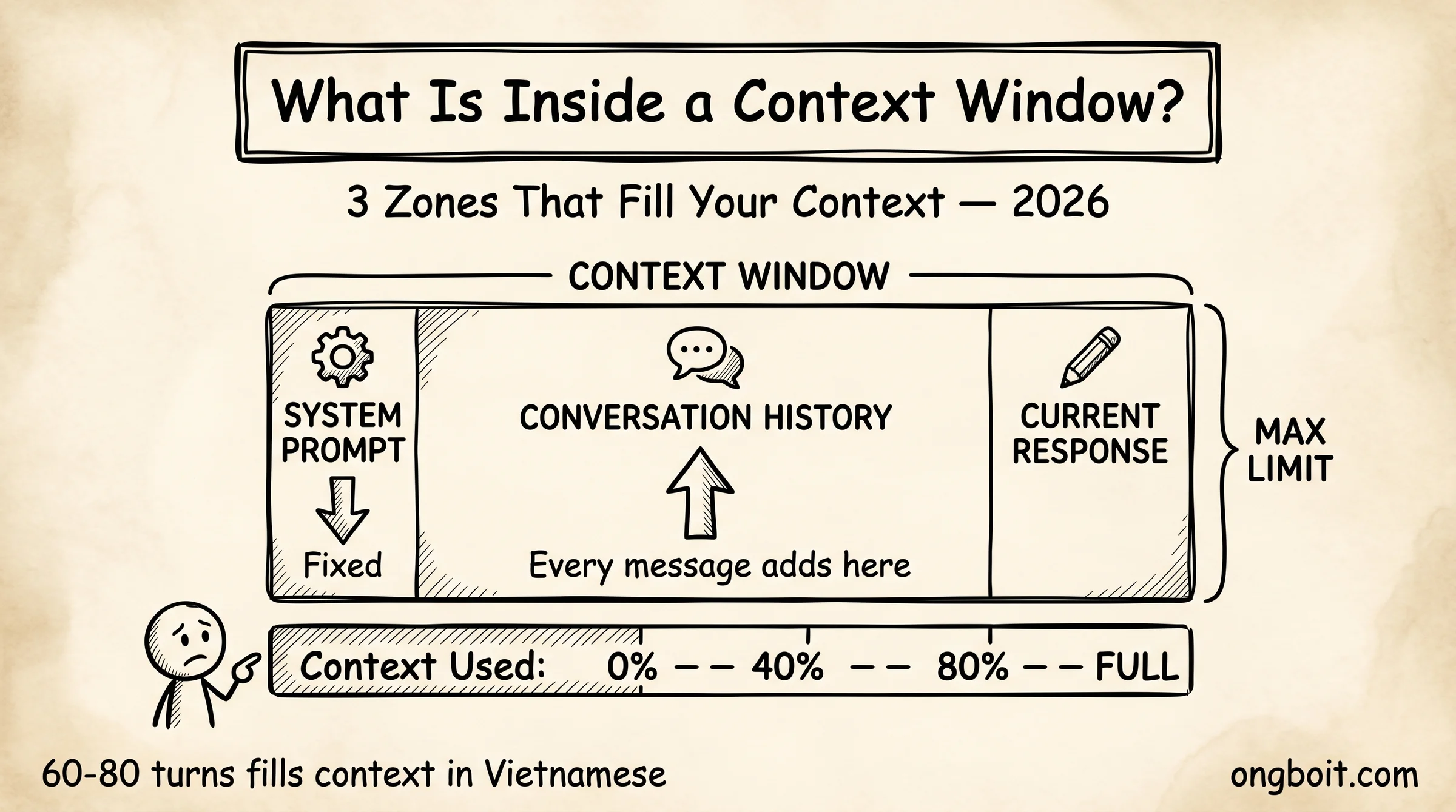

Context window không chỉ là lịch sử chat. Nó bao gồm system prompt (hướng dẫn ban đầu), toàn bộ lịch sử hội thoại, tài liệu bạn paste vào, đoạn code bạn chia sẻ, và câu trả lời AI đang tạo ra. Tất cả cộng lại phải vừa trong giới hạn token của model.

Khái niệm này hay bị nhầm với “bộ nhớ dài hạn”. Thực ra context window là bộ nhớ ngắn hạn, giống RAM máy tính: nhanh và tức thì, nhưng có giới hạn và mất sạch khi bạn bắt đầu session mới.

Tại Sao Context Window Quan Trọng Với Developer?

Context window quyết định bao nhiêu thông tin bạn có thể đưa vào một lần, và AI có thể “nhìn thấy” bao xa về phía trước trong cuộc hội thoại. Với developer, điều đó ảnh hưởng trực tiếp đến 3 tình huống cụ thể.

Review code lớn: Muốn Claude review một file 2,000 dòng code, bạn cần đủ context để chứa toàn bộ file cộng với conversation. Nếu context window quá nhỏ, phải chia nhỏ file và review từng phần, dễ bỏ sót bug cross-section.

Hội thoại dài: Khi debug một vấn đề phức tạp qua nhiều lượt trao đổi, context window quyết định AI nhớ được bao xa. GPT-4o với 128K token bắt đầu “quên” sau khoảng 100-150 lượt chat trung bình. Claude Sonnet 4.6 với 1M token có thể duy trì hội thoại dài hơn nhiều.

Xử lý tài liệu: Muốn tóm tắt một báo cáo 50 trang, toàn bộ nội dung phải vừa vào context window. Model có context window 128K xử lý được khoảng 100 trang tiếng Anh, hay chỉ khoảng 40-50 trang tiếng Việt do Language Tax.

Context Window Chứa Những Gì Bên Trong?

Context window chứa tất cả thông tin trong một session, chia thành 3 phần chính, và mỗi phần đều tốn token.

System prompt là phần đầu tiên và cố định. Nếu bạn dùng Claude Code với CLAUDE.md, toàn bộ nội dung CLAUDE.md được đưa vào đây. Một CLAUDE.md 500 từ tốn khoảng 650-700 token cho mỗi lần gọi API. Phần này bạn kiểm soát được và nên tối ưu kỹ.

Conversation history là phần lớn nhất và tăng theo thời gian. Mỗi lượt bạn hỏi và AI trả lời đều được thêm vào đây. Sau 50 lượt chat về một codebase phức tạp, conversation history có thể chiếm 100K-200K token. Đây là phần “rò rỉ” context window nhanh nhất.

Current response là phần AI đang tạo ra. Token output cũng tính vào context window, nên câu trả lời càng dài, context càng thu hẹp.

So Sánh Context Window: Claude vs GPT-4o

Bảng so sánh context window các model AI phổ biến nhất hiện tại (tháng 4/2026):

| Model | Context Window | Input ($/1M token) | Tương đương tiếng Anh |

|---|---|---|---|

| Claude Sonnet 4.6 | 1,000,000 token | $3.00 | ~750,000 từ |

| Claude Haiku 4.5 | 200,000 token | $0.80 | ~150,000 từ |

| GPT-4o | 128,000 token | $2.50 | ~96,000 từ |

| GPT-4o mini | 128,000 token | $0.15 | ~96,000 từ |

| Gemini 1.5 Pro | 1,000,000 token | $1.25 | ~750,000 từ |

| Gemini 1.5 Flash | 1,000,000 token | $0.075 | ~750,000 từ |

Nguồn: Anthropic pricing docs và OpenAI API pricing, xác minh 04/2026.

Điểm cần chú ý: context window lớn không có nghĩa là rẻ hơn. Claude Sonnet 4.6 có 1M token context nhưng input giá $3/MTok. GPT-4o mini chỉ có 128K nhưng giá $0.15/MTok. Nếu task của bạn không cần context dài, model context window nhỏ + giá rẻ thường là lựa chọn tốt hơn.

Tại Sao Tiếng Việt Làm Context Window Đầy Nhanh Hơn?

Đây là điểm mà không ai trong top 10 Google cho “context window là gì” đề cập đến. Effective Context Window của người dùng tiếng Việt thấp hơn rõ rệt so với tiếng Anh, dù dùng cùng một model.

Lý do liên quan đến Language Tax đã giải thích trong bài token là gì: tiếng Việt tốn 2-5x token so với tiếng Anh cho cùng một lượng thông tin. Điều đó có nghĩa là:

- Claude Sonnet 4.6 quảng cáo 1M token context

- Bài blog tiếng Việt 1,500 chữ tốn 4,500-5,500 token

- Bài tiếng Anh tương đương chỉ tốn 2,000-2,500 token

- Effective Context Window thực tế cho tiếng Việt: 200K-500K token (20-50% nominal)

Mình tính cụ thể: với Claude Sonnet 4.6 và một workflow viết bài blog tiếng Việt, context bắt đầu đầy sau khoảng 60-80 lượt trao đổi khi làm việc với code và nội dung dài. Với tiếng Anh, con số đó gần gấp đôi.

Kết quả thực tế: developer Việt cần quản lý context chủ động hơn so với đồng nghiệp dùng tiếng Anh. Effective Context Window không phải khái niệm lý thuyết, mà là con số bạn nên tính toán trước khi chọn model và thiết kế workflow.

Context Window Bị Đầy Thì Phải Làm Gì?

Khi context window đầy, AI có hai hành vi: hoặc báo lỗi “context limit exceeded”, hoặc tự động đẩy phần đầu hội thoại ra ngoài và “quên” nó. Cả hai đều gây ra vấn đề. Có 4 cách xử lý mình dùng thực tế.

1. Dùng CLAUDE.md cho context tĩnh. Thay vì paste system instructions vào đầu mỗi conversation, đặt nó vào CLAUDE.md. Claude Code tự động load file này mà không tốn conversation turns. CLAUDE.md 500 từ tốn token như nhau dù bạn có 5 hay 500 lượt chat tiếp theo.

2. Gọi /clear trước task mới. Lệnh /clear trong Claude Code reset context về zero, giữ lại CLAUDE.md nhưng xóa toàn bộ conversation history. Hiệu quả nhất khi bạn chuyển từ task này sang task khác không liên quan, ví dụ từ debug lỗi sang viết tài liệu.

3. Tóm tắt conversation trước khi context đầy. Khi đang giữa một task phức tạp, yêu cầu Claude “tóm tắt những gì đã thống nhất và quyết định quan trọng trong conversation này” rồi paste tóm tắt đó vào session mới. Giữ được logic, mất conversation noise.

4. Tách session theo chức năng. Đừng giải quyết mọi thứ trong một session. Review code một session, viết docs một session, debug một session. Mỗi session bắt đầu sạch với đúng context cần thiết.

Khi build automation pipeline cho Claude Code tại ongboit.com, mình kết hợp cả 4 cách: CLAUDE.md cho project context, /clear sau mỗi bài viết, tóm tắt trạng thái nếu cần tiếp tục từ chỗ dở. Kết quả: ít lần context crash hơn, và khi crash thì recovery nhanh hơn.

Nếu muốn tối ưu sâu hơn, đọc bài tiết kiệm token Claude Code về các kỹ thuật nén context.

Context Window Khác Bộ Nhớ Dài Hạn (RAG) Thế Nào?

Developer hay nhầm context window với “bộ nhớ AI”. Thực ra đây là hai thứ khác nhau hoàn toàn.

Context window là RAM của AI: tức thì, không cần query, nhưng giới hạn dung lượng và mất khi session kết thúc. Mọi thứ trong context window đều được model “nhìn thấy” trực tiếp trong một lần xử lý.

RAG (Retrieval-Augmented Generation) là ổ cứng của AI: không giới hạn dung lượng, tồn tại qua nhiều session, nhưng phải query mới lấy được data và chỉ retrieve đúng phần liên quan, không phải toàn bộ.

Với developer dùng Claude Code, analogy cụ thể hơn: CLAUDE.md là “pinned RAM” (luôn trong context), conversation history là “active RAM” (tăng dần theo session), MCP memory tools và vector database là “SSD cache” (persistent, query-based). Biết phân biệt ba loại này giúp bạn quyết định thông tin nào nên đặt ở đâu thay vì nhét tất cả vào conversation và lãng phí Effective Context Window.

Câu Hỏi Thường Gặp

Context window là gì trong AI?

Context window là số token tối đa một AI model có thể đọc và xử lý trong một lần. Nó bao gồm system prompt, toàn bộ lịch sử hội thoại, tài liệu bạn đưa vào, và câu trả lời AI đang tạo. Vượt quá giới hạn này, AI sẽ quên phần đầu hội thoại hoặc báo lỗi. Claude Sonnet 4.6 có context window 1 triệu token, GPT-4o có 128K token.

Context window bị đầy thì AI làm gì?

Khi context window đầy, model xử lý theo một trong hai cách: đẩy phần đầu hội thoại ra ngoài (sliding window, AI “quên” thông tin cũ), hoặc báo lỗi “context limit exceeded” và từ chối xử lý thêm. Với Claude Code, bạn thấy thông báo này khi conversation quá dài. Giải pháp: dùng /clear để reset, hoặc tóm tắt conversation rồi bắt đầu session mới.

Context window khác context length thế nào?

Không khác gì. “Context window” và “context length” là hai tên gọi cho cùng một khái niệm: số token tối đa model xử lý trong một lần. Anthropic hay dùng “context window”, OpenAI hay dùng “context length”, một số tài liệu dùng “token limit”. Cả ba đều chỉ cùng một giới hạn.

Tại sao context window của Claude lớn hơn GPT-4o?

Claude Sonnet 4.6 có context 1M token vs GPT-4o 128K vì Anthropic ưu tiên long-context use cases. Context window lớn hơn không có nghĩa tốt hơn trong mọi tình huống: attention mechanism có độ phức tạp O(n²) theo context length, nên model context dài cần nhiều compute hơn và phản hồi chậm hơn với context đầy. GPT-4o mini với 128K token và giá $0.15/MTok thường đủ dùng và rẻ hơn nhiều cho task ngắn.

Context window 1 triệu token tương đương bao nhiêu?

Với tiếng Anh, 1M token tương đương khoảng 750,000 từ hay 1,500 trang A4. Với tiếng Việt, do Language Tax, con số thực tế chỉ còn khoảng 150K-375K từ, tức 300-750 trang A4. Bài blog tiếng Việt 1,500 chữ chiếm khoảng 4,500-5,500 token, và một Claude Code session xử lý 100 bài blog như vậy sẽ dùng 450K-550K token.

Kết Luận

Context window là giới hạn bộ nhớ làm việc của AI. Hiểu nó giúp bạn làm việc với AI có chiến lược hơn, không chỉ dùng tới khi gặp lỗi mới biết.

Điểm quan trọng nhất cho developer Việt: Effective Context Window thực tế nhỏ hơn con số quảng cáo 2-5 lần vì Language Tax. Claude Sonnet 4.6 quảng cáo 1M token, nhưng khi viết code và tài liệu bằng tiếng Việt, bạn làm việc với context hiệu dụng gần hơn 200K-500K.

Bước tiếp theo: xem bài tiết kiệm token Claude Code để biết cách tối ưu context window trong workflow thực tế, từ cách viết CLAUDE.md ngắn gọn đến kỹ thuật tách task giảm context waste.

Kiến thức nền này sẽ giúp bạn học Claude Code hiệu quả hơn. Xem lộ trình 8 levels để biết bước tiếp theo.