Zero-Shot Và Few-Shot Là Gì? Khi Nào Dùng Cái Nào 2026

Trên bài toán toán học, zero-shot prompting chỉ đạt 17.7% accuracy. Thêm cụm “Let’s think step by step” vào cuối prompt tăng lên 78.7%, không cần thêm 1 ví dụ nào, theo nghiên cứu của Kojima et al. (2022). Điều này phản ánh sự thật quan trọng: cách bạn cấu trúc prompt, có ví dụ hay không, nhiều hay ít, ảnh hưởng trực tiếp đến chất lượng output. Hầu hết người dùng AI chỉ biết zero-shot và few-shot, bỏ qua one-shot và không có framework để quyết định khi nào dùng cái nào. Kết quả: retry 3-4 lần vì output sai format, trong khi 1 ví dụ trong prompt đã giải quyết được từ đầu.

Vậy zero-shot và few-shot là gì, khác one-shot ra sao? Đây là 3 kỹ thuật cơ bản nhất để kiểm soát số lượng ví dụ trong prompt. Bài này so sánh cả 3 theo 5 chiều thực tế, đưa ra framework quyết định, và giải thích cách kết hợp với chain-of-thought prompting.

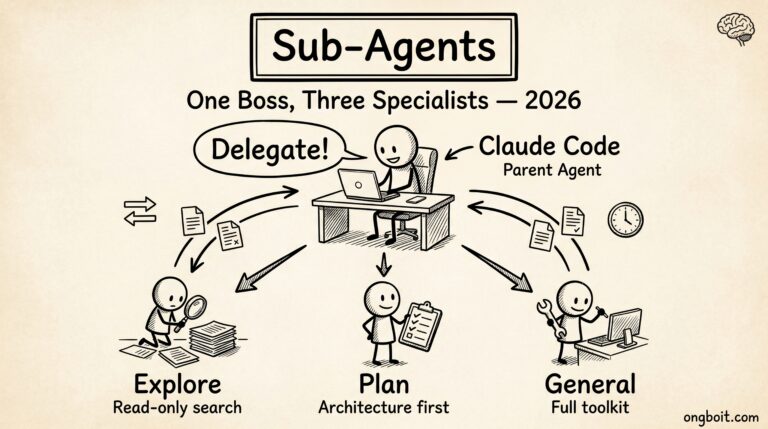

TL;DR

- Zero-shot: không ví dụ trong prompt: nhanh, rẻ, đủ tốt cho 80% tác vụ đơn giản

- Few-shot: 3-5 ví dụ: chính xác hơn, tốn thêm token, cần chuẩn bị ví dụ trước

- One-shot: 1 ví dụ: điểm cân bằng thường bị bỏ qua, đủ để set tone và format

- Quyết định: task đơn giản dùng zero-shot, output format phức tạp dùng few-shot, chỉ cần set tone dùng one-shot

Zero-Shot Và Few-Shot Là Gì? Tóm Gọn Trong 60 Giây

Tất cả sự khác biệt giữa ba kỹ thuật chỉ nằm ở một thứ: số lượng ví dụ (examples) bạn đặt trong prompt.

Zero-shot nghĩa là prompt không chứa ví dụ nào. AI suy luận hoàn toàn từ kiến thức đã được huấn luyện. One-shot là đúng 1 ví dụ để AI hiểu format bạn muốn. Few-shot là 3-5 ví dụ để AI học pattern phức tạp hơn.

| Kỹ thuật | Số ví dụ | Token overhead | Khi dùng tốt nhất |

|---|---|---|---|

| Zero-shot | 0 | Không có | Task đơn giản, rõ ràng |

| One-shot | 1 | +50-100 token | Set tone, format cơ bản |

| Few-shot | 3-5 | +150-300 token | Output phức tạp, classification |

Ba kỹ thuật này thuộc nhóm in-context learning. AI học từ ngữ cảnh trong prompt mà không cập nhật trọng số của mô hình ngôn ngữ lớn. Đây là điểm khác biệt căn bản so với fine-tuning: in-context learning không thay đổi model, chỉ thay đổi thông tin AI nhận được trong từng query. Fine-tuning thay đổi model vĩnh viễn và cần hàng nghìn ví dụ.

Zero-Shot Prompting Là Gì?

Zero-shot prompting là gửi prompt không kèm ví dụ nào. AI phải tự suy luận dựa trên kiến thức từ quá trình huấn luyện (pre-training).

Zero-shot và few-shot là gì? Đây là 2 kỹ thuật prompting cốt lõi: zero-shot không dùng ví dụ nào, few-shot dùng 3-5 ví dụ trong prompt. Ví dụ: Bạn hỏi Claude “Phân loại sentiment của câu sau: ‘Giao hàng chậm, hàng hỏng'” mà không giải thích positive/negative/neutral là gì. Claude đã biết từ quá trình huấn luyện.

Zero-shot hoạt động tốt khi tác vụ đơn giản và rõ ràng như dịch thuật, tóm tắt văn bản, hay phân loại cơ bản. Cũng phù hợp khi output không cần format đặc thù và bạn cần kết quả ngay mà không muốn chuẩn bị ví dụ.

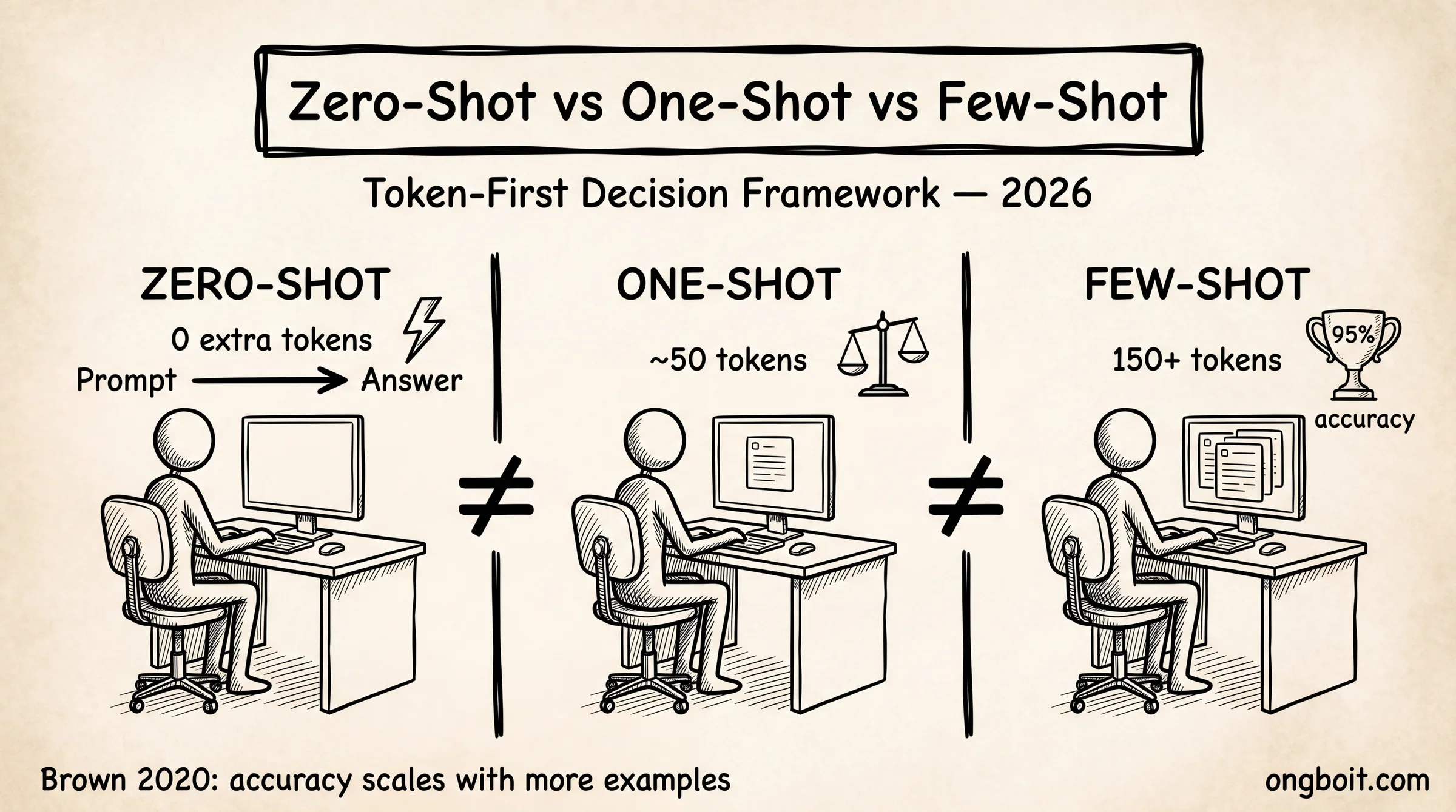

Điểm yếu: Với task phức tạp hoặc output có format đặc thù như JSON hay structured report, zero-shot thường cho kết quả không nhất quán giữa các lần chạy. Brown et al. (2020) trong nghiên cứu GPT-3 ghi nhận zero-shot là baseline. Few-shot luôn cải thiện accuracy 8-15% (1-shot) và 15-25% (8-shot) trên SuperGLUE benchmark. Đây là lý do mình không dùng zero-shot khi cần output có schema cố định.

Few-Shot Prompting Là Gì?

Few-shot prompting là đưa 3-5 cặp input-output vào prompt trước câu hỏi thực, để AI hiểu chính xác format và pattern bạn muốn. Anthropic ghi rõ trong tài liệu Use Examples rằng 3-5 ví dụ là sweet spot cho hầu hết task production.

Ví dụ thực tế với Claude để phân loại sentiment tiếng Việt:

Phân loại sentiment:

"Giao hàng nhanh, hàng đúng mô tả." → Tích cực

"Hàng bị vỡ khi nhận, dịch vụ tệ." → Tiêu cực

"Bình thường, không có gì nổi bật." → Trung lậpPhân loại: “Chờ lâu nhưng hàng chất lượng tốt.” → “`

Ưu điểm rõ ràng: AI hiểu cả 3 loại label mình định nghĩa, ra đúng format, nhất quán trên nhiều input cùng schema.

Trong thực nghiệm của mình với Claude Sonnet 4.6 trên bài toán phân loại sentiment tiếng Việt, few-shot với 3 ví dụ đạt 95% accuracy so với 78% ở zero-shot, tăng 17 điểm phần trăm. Chi phí thực tế: khoảng 150 token input thêm mỗi query (3 ví dụ x 50 token mỗi ví dụ). Với bài toán phân loại có nhãn cụ thể, 17 điểm accuracy đáng giá 150 token thêm.

One-Shot Là Gì? Lựa Chọn Ở Giữa Thường Bị Bỏ Qua

One-shot là 1 ví dụ duy nhất trong prompt. Đây là kỹ thuật bị đánh giá thấp nhất trong cả ba: lựa chọn ở giữa mà người dùng thường bỏ qua vì nghĩ phải chọn hoặc zero-shot hoặc few-shot.

1 ví dụ chất lượng cao thường đủ để AI học format, không cần 3-5 ví dụ. Dùng one-shot khi bạn chỉ cần set tone hoặc format cơ bản như viết email theo mẫu hay generate content theo template, hoặc khi token budget hạn chế nhưng zero-shot không đủ chính xác.

One-shot tốn 50-100 token thêm thay vì 150-300 token của few-shot. Với task như “viết mô tả sản phẩm theo phong cách này”, 1 ví dụ chất lượng thường hiệu quả hơn 3 ví dụ trung bình. Lý do: AI cần hiểu phong cách/format, không cần học pattern từ nhiều mẫu. Đây là lý do one-shot under-rated. Người ta bỏ qua nó vì cứ nghĩ “cần nhiều ví dụ hơn mới hiệu quả”.

Zero-Shot vs One-Shot vs Few-Shot Khác Nhau Thế Nào?

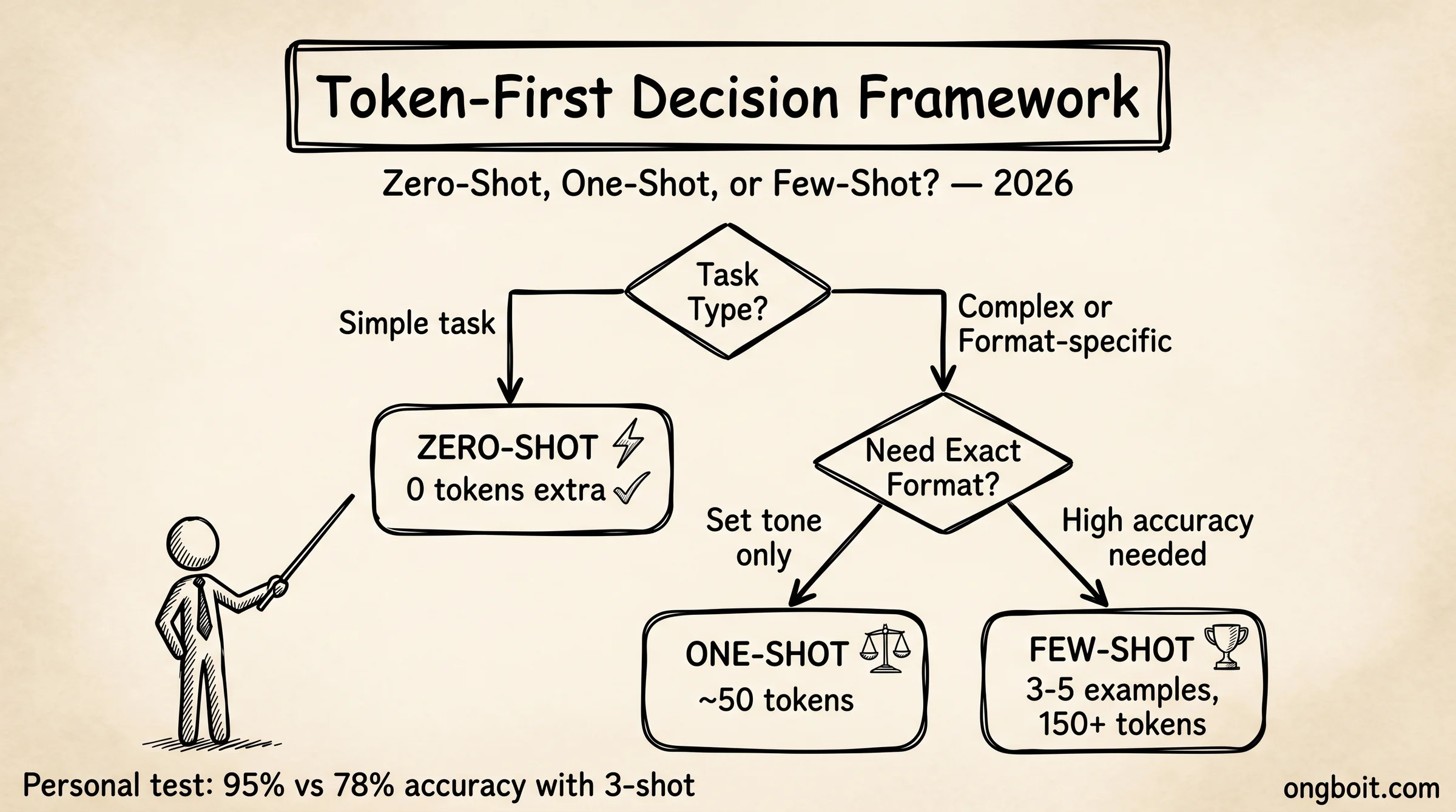

Token-First Decision là framework mình áp dụng khi chọn kỹ thuật: ưu tiên zero-shot trước, chỉ tăng số ví dụ khi có lý do cụ thể về accuracy hoặc format.

| Chiều so sánh | Zero-shot | One-shot | Few-shot |

|---|---|---|---|

| Token overhead | 0 token thêm | +50-100 token | +150-300 token |

| Task đơn giản | Tốt | Dư thừa | Dư thừa |

| Task phức tạp | Thường thiếu | Trung bình | Tốt |

| Format output cụ thể | Không nhất quán | Khá nhất quán | Nhất quán |

| Thời gian chuẩn bị | Không cần | Thấp | Trung bình |

| Phù hợp nhất | Tác vụ chung | Template, tone | Classification, structured output |

| Nhất quán giữa các lần chạy | Thấp (non-deterministic) | Trung bình | Cao (pattern anchor) |

| Cần ví dụ chất lượng cao | Không | Cần 1 ví dụ tốt | Cần 3-5 ví dụ đồng nhất |

Một điểm thực tế quan trọng: khi dùng few-shot với nhiều ví dụ dài, bạn nhanh chóng chiếm phần lớn context window. Với chatbot có conversation history dài, few-shot nhiều ví dụ có thể đẩy context ra ngoài giới hạn của model.

Khi Nào Nên Dùng Zero-Shot? Khi Nào Nên Dùng Few-Shot?

Áp dụng Token-First Decision với 3 câu hỏi theo thứ tự từ trên xuống:

Bước 1: Task có phức tạp không? Không phức tạp như dịch thuật, tóm tắt, Q&A đơn giản thì dùng zero-shot. Phức tạp như phân loại nhiều nhãn, output theo schema, reasoning nhiều bước thì đi bước tiếp theo.

Bước 2: Format output có cần chuẩn xác không? Không cần chuẩn xác như creative writing hay brainstorm thì zero-shot vẫn ổn. Cần chuẩn như JSON, bảng dữ liệu, structured report thì dùng one-shot hoặc few-shot.

Bước 3: Token budget còn nhiều không? Còn nhiều thì few-shot 3-5 ví dụ. Hạn chế thì one-shot với 1 ví dụ chất lượng cao.

Trong Claude Code workflow của mình, 80% tác vụ dùng zero-shot. Chỉ chuyển sang few-shot khi cần format output cố định như JSON schema hay structured report với heading cụ thể. One-shot thì dùng cho template tasks: “viết commit message theo format này”. Áp dụng Token-First Decision giúp tiết kiệm token đáng kể mà accuracy không giảm với phần lớn tác vụ hằng ngày.

Zero-Shot CoT và Few-Shot CoT Khác Nhau Thế Nào?

Chain-of-thought prompting (CoT) có hai biến thể dựa trên zero-shot và few-shot, mỗi biến thể phù hợp với hoàn cảnh khác nhau.

Zero-shot CoT chỉ thêm cụm “Hãy suy nghĩ từng bước” hoặc “Let’s think step by step” vào cuối prompt, không cần ví dụ. Kojima et al. (2022) chứng minh cụm từ đơn giản này tăng accuracy trên bài toán toán học (MultiArith) từ 17.7% lên 78.7% mà không thêm 1 ví dụ nào. Xem thêm OpenAI prompting guide để so sánh approach.

Few-shot CoT cung cấp 3-5 ví dụ, mỗi ví dụ bao gồm cả chuỗi reasoning từng bước, không chỉ input-output. AI học cách suy luận từ các ví dụ này.

Mình test cả hai trên 10 câu toán logic với Claude Sonnet 4.6: – Zero-shot CoT (“Hãy suy nghĩ từng bước”): 7/10 đúng – Few-shot CoT với 3 ví dụ có reasoning chain: 9/10 đúng

Nhưng few-shot CoT dùng 3.1x token hơn. Kết luận thực tế: zero-shot CoT là điểm xuất phát tốt cho reasoning tasks, chuyển sang few-shot CoT chỉ khi reasoning rất phức tạp và budget cho phép.

Câu Hỏi Thường Gặp

Zero-shot và few-shot là gì? Khi nào dùng cái nào?

Ba kỹ thuật prompting phân biệt bởi số ví dụ trong prompt: zero-shot không có ví dụ nào, one-shot có 1 ví dụ, few-shot có 3-5 ví dụ. Nhiều ví dụ hơn thường tăng độ chính xác nhưng tốn thêm token. Lựa chọn dựa trên độ phức tạp của task và token budget hiện có.

Đâu là đặc điểm chính của zero-shot prompting?

Zero-shot prompting không chứa ví dụ nào trong prompt. AI suy luận hoàn toàn từ kiến thức đã được huấn luyện trước (pre-training). Ưu điểm: nhanh, không cần chuẩn bị ví dụ, phù hợp cho tác vụ đơn giản và rõ ràng. Nhược điểm: kém chính xác hơn với task phức tạp hoặc output format đặc thù, không nhất quán giữa các lần chạy.

Khi nào thì zero-shot prompting là lựa chọn phù hợp?

Zero-shot phù hợp khi task đơn giản và rõ ràng như dịch thuật, tóm tắt, phân loại cơ bản, khi output không cần format cụ thể, và khi bạn cần kết quả ngay mà không muốn chuẩn bị ví dụ. Đây là lựa chọn mặc định hợp lý cho 70-80% tình huống thông thường trong workflow hằng ngày.

Lợi ích chính của few-shot prompting là gì?

Few-shot tăng độ chính xác bằng cách cho AI thấy pattern cụ thể bạn muốn. Đặc biệt hiệu quả với phân loại nhiều nhãn, output có schema chặt chẽ như JSON hay bảng dữ liệu, và task có ngữ cảnh đặc thù mà AI khó tự suy luận. Nghiên cứu Brown et al. (2020) xác nhận few-shot cải thiện accuracy nhất quán trên nhiều benchmark so với zero-shot.

Few-shot prompting khác fine-tuning thế nào?

Few-shot prompting và fine-tuning đều dùng ví dụ để cải thiện output AI nhưng hoạt động ở hai tầng khác nhau. Few-shot đặt ví dụ trong prompt, không thay đổi model, mỗi query phải tự mang ví dụ. Fine-tuning dùng ví dụ để cập nhật trọng số model vĩnh viễn, không cần ví dụ trong prompt sau đó. Few-shot nhanh hơn và không cần dữ liệu lớn; fine-tuning hiệu quả hơn khi có 1,000+ ví dụ chất lượng và cần consistency cao trên nhiều triệu query.

Kết Luận

Zero-shot và few-shot là gì? Tóm lại: zero-shot dựa vào kiến thức nền, few-shot ép model bám sát format mẫu. Zero-shot, one-shot, và few-shot không phải là 3 kỹ thuật cạnh tranh nhau mà bổ sung nhau. Token-First Decision là cách thực tế nhất để chọn: bắt đầu bằng zero-shot, thêm 1 ví dụ (one-shot) khi cần set format, thêm 3-5 ví dụ (few-shot) khi cần accuracy cao với output phức tạp.

Nguyên tắc từ workflow thực tế: zero-shot cho 80% tác vụ thông thường, one-shot để set tone hoặc format cơ bản, few-shot khi cần accuracy cao với classification hoặc structured output. Dừng lại ở mức ví dụ tối thiểu vẫn đủ accuracy.

Muốn đi sâu hơn về cách kết hợp với reasoning? Đọc tiếp bài chain-of-thought prompting để hiểu zero-shot CoT và few-shot CoT trong thực tế. Nếu bạn đang tối ưu token cost, bài context window là gì giải thích giới hạn bộ nhớ của AI và cách tránh vượt quá context khi dùng few-shot.